En este artículo vamos a tratar de forma sencilla los diversos parámetros del vídeo digital. Es importante conocer estos conceptos antes de comenzar a trabajar de forma técnica con los diferentes assets audiovisuales, ya sea en edición de vídeo, efectos visuales, corrección de color u otra técnica de posproducción.

Table of Contents

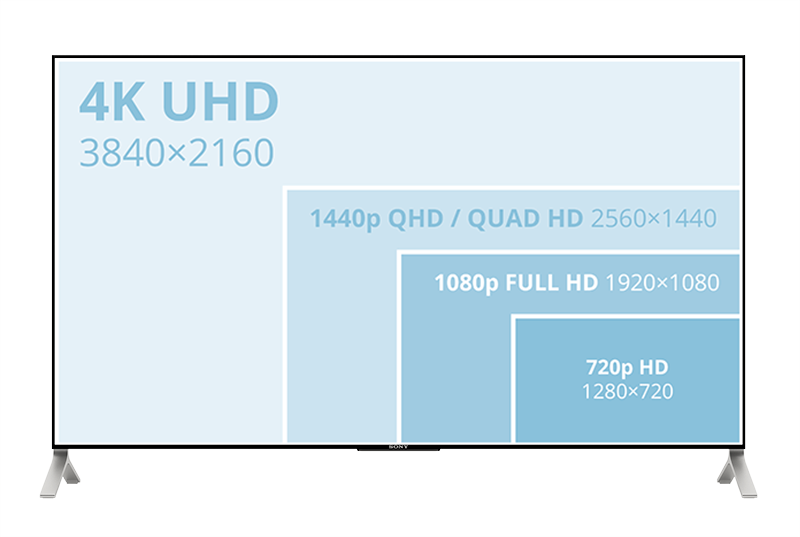

Resolución

Aunque el concepto resolución a veces es utilizado para referirse a la densidad de píxeles por unidad de longitud (por ejemplo, 72 píxeles por pulgada), en el contexto del vídeo se utiliza para referirse al número de píxeles por fila y columna de cada frame del vídeo (por ejemplo, Full HD es una resolución de 1920×1080 píxeles).

El píxel (unidad mínima de imagen)

Un píxel (a partir de ahora «px), por su parte, es la unidad mínima de información mostrada en pantalla y que tiene forma rectangular (no siempre cuadrada, como veremos más adelante).

Relación de aspecto

La relación de aspecto es la relación entre anchura y altura real de un frame del vídeo; por poner un ejemplo, una resolución de 1280x720px tiene una relación de aspecto de 16:9, asumiendo que los píxeles son cuadrados.

PAR (Pixel Aspect Ratio)

Es un concepto un tanto confuso porque generalmente los píxeles son cuadrados, pero no siempre es así. Algunas formatos plantean una reducción del número de píxeles horizontales manteniendo la misma relación de aspecto, lo que provoca que el píxel sea (o deba mostrarse) más ancho que alto; como ejemplo encontramos el formato HDV, que consiste en una resolución de 1440x1080px y relación de aspecto de 16:9, lo cual provoca una relación de aspecto de píxel (PAR) de 1.33.

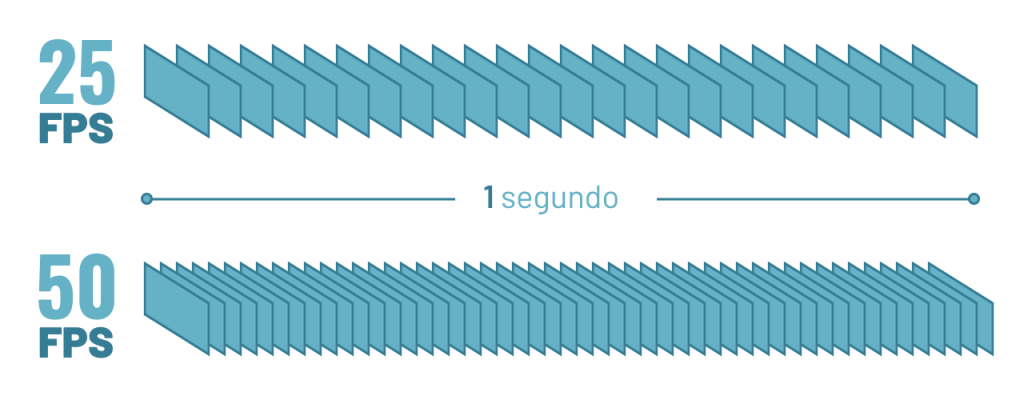

FPS (Frames por segundo)

Los FPS (Frames per Second) son el número de imágenes completas (llamados cuadros o frames) que se muestran cada segundo. En vídeo digital es común encontrar FPS de 24, 30, 50, 60, etc.

Cuando tratamos con vídeo entrelazado, el cual es un método de reducción de información a transmitir heredado de la televisión analógica, hablamos de campos por segundo. Dicho de un modo simple, un campo es el equivalente a la mitad de un frame, de forma que 25 fps equivalen a 50 campos por segundo y viceversa.

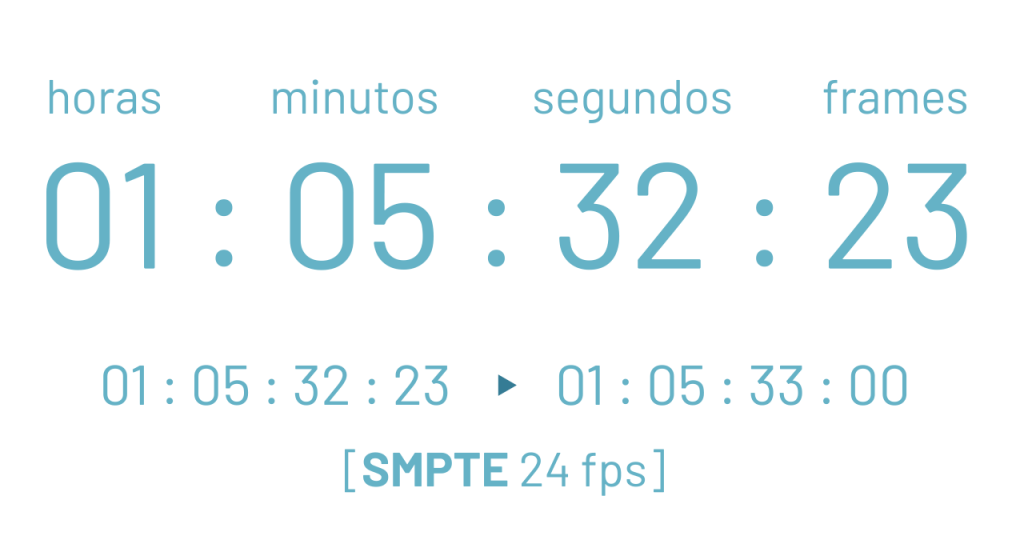

Duración y timecode

La duración de un vídeo es el tiempo que dura su reproducción, aunque el resultado es diferente en función de la velocidad de reproducción. En este sentido, es más exacto hablar del número total de frames que el vídeo tiene.

El timecode es una representación temporal del número de frames, por lo que involucra una velocidad de reproducción. En este sentido, no es lo mismo hablar de un timecode basado en 30fps o de uno basado en 24fps, ya que provocará que la duración del vídeo reproducido sea diferente. El sistema de timecode típico que veremos en las aplicaciones es el código de tiempo SMPTE (creado por la «Society of Motion Picture and Television Engineers»), un estándar que etiqueta los diferentes frames de un vídeo con un código temporal.

Es importante reproducir un vídeo a la misma velocidad que el sistema de grabación capturó, ya que si no estaremos deformando temporalmente dicho vídeo, acelerándolo o desacelerándolo. También se debe tener cuidado a la hora de editar vídeo, configurando nuestro proyecto adecuadamente y procurando no mezclar material de diferentes FPS (hay veces en que no queda más remedio, y se deberán tratar de forma especial para no caer en errores típicos de desincronía).

Sistema de color

En vídeo digital trataremos generalmente con dos sistemas de color: RGB y YUV. Hablamos de RGB cuando la señal de vídeo tiene 3 canales (rojo, verde y azul) y de YUV cuando la señal tiene canal de luminancia y dos de color (a veces denominados «de diferencia de color»).

Es muy común encontrar el vídeo en sistema YUV, ya que es la forma en que graban vídeo la mayoría de las cámaras digitales. Además, la mayoría de los códecs aplican compresión (chroma subsampling) sobre los canales de color U y V.

Puede que nos encontremos con las siglas YCbCr; en ese caso las interpretaremos como YUV, aunque tienen cierta diferencia técnica en su codificación, siendo el uso de YCbCr más adecuado en el contexto digital.

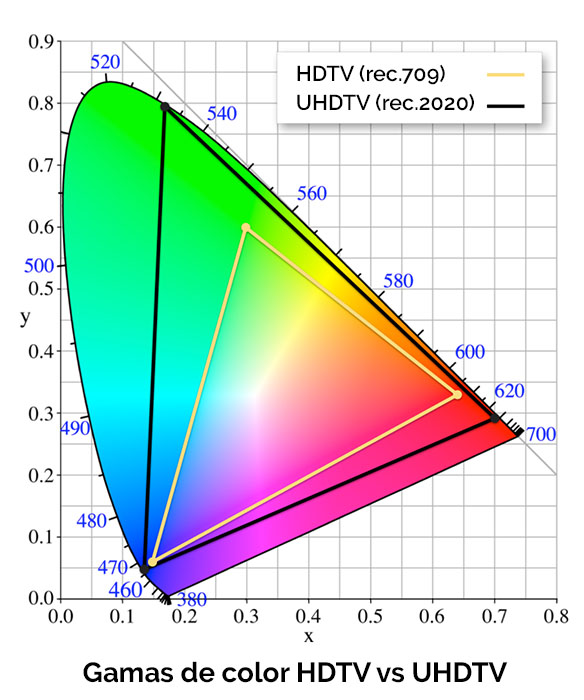

Espacio de color

Los espacios de color son complejos de entender en su totalidad, por lo que veremos un acercamiento sencillo en este post.

Podemos definir un espacio de color como la representación matemática de una determinada gama de colores (a veces llamado gamut).

Al igual que en fotografía es común encontrar el sRGB y el AdobeRGB como espacios de color para sistemas RGB, en vídeo es común encontrar los llamados rec.601 (para definición estándar o SD), rec.709 (para alta definición o HD) o rec.2020 (para ultra alta definición o UHD). Los «rec» mencionados son realmente estándares para sistemas de color YUV y que no sólo definen una gama de color, sino que especifican cómo debe codificarse cada color digitalmente (hablaremos de ellos en profundidad en otro post).

La idea con la que nos quedaremos es que un espacio de color determina un conjunto de colores a mostrar, y que nunca llega a cubrir el espectro de color completo, habiendo espacios de color más amplios (con más colores) y más reducidos (con menos colores).

Los espacios de color se dibujan dentro de un diagrama CIE 193 (el cual representa todo el espectro visible de color) y se representa el conjunto de colores que tal espacio de color abarca. A continuación se muestra una comparativa de los espacios de color rec.709 y rec.2020, usados como estándar para emisiones de televisión digital hoy en día:

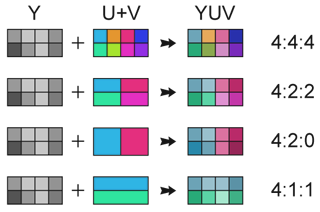

Subsampling de color

El subsampling de color se conoce en inglés como chroma subsampling, y es una técnica de compresión de la información de color que consiste en muestrear las señales de color con menor frecuencia que la señal de luminancia. Se aplica, por tanto, sobre señales en modo YUV (Y para luminancia, UV para señales de diferencia de color).

Su principal objetivo es reducir la información de color enviada, ya que el ojo humano es más sensible a la información lumínica (información de brillo transportada por la señal de luminancia Y). De esta forma se logra reducir la cantidad de información y, por tanto, se logra ahorrar ancho de banda.

Profundidad de bits

La profundidad de bits es el número de bits utilizado para codificar cada muestra de información de vídeo. Normalmente nos encontraremos con 8 bits por muestra, pero muchos códecs ofrecen la posibilidad de codificar la información con 10, 12 o incluso 16 bits, lo cual da mayor precisión a la señal final de vídeo.

Tasa de datos o Bitrate

El bitrate es la cantidad de bits por segundo de un determinado flujo de datos. Cuanto mayor sea el bitrate mayor será la cantidad de información que podemos enviar con tal flujo de datos, y mayor será el ancho de banda requerido para éste. Trasladado al contexto del vídeo, mayor será lsu calidad, pudiendo albergar más colores, más detalle, más resolución, etc.

Se debe tener en cuenta que algunos códecs suelen tener la opción de generar vídeo en dos tipos de bitrates: bitrates constantes (CBR) y bitrates variables (VBR). El VBR es más óptimo ya que sólo se usarán altos flujos de información en escenas que lo requieran (aquellas con mucho movimiento y detalle); sin embargo, puede no ser válido para ciertas transmisiones que requieran estabilidad o tengan un ancho de banda limitado.

CBR (Constant Bitrate)

El CBR consiste en un flujo de datos constante a lo largo del tiempo. Es útil cuando queremos que un vídeo tenga un flujo de datos constante, de forma que no se generen picos de información que puedan saturar el ancho de banda de una determinada emisión.

VBR (Variable Bitrate)

El VBR es más óptimo ya que sólo se usarán altos flujos de información en escenas que lo requieran (aquellas con mucho movimiento y detalle); sin embargo, puede no ser válido para ciertas transmisiones que requieran estabilidad o tengan un ancho de banda limitado.

Formato y códecs

El vídeo digital se almacena es contenedores capaces de embeber diferentes flujos de datos (como pueden ser vídeo, audio y subtítulos). Estos contenedores reciben el nombre de formato.

Por otro lado tenemos los códecs, que son los programas informáticos capaces de codificar y decodificar los diferentes flujos de datos, que luego serán incluidos en el mencionado formato contenedor.

Formato contenedor

Un formato contenedor es el archivo que finalmente va a contener la información generada por un códec, ya sea de vídeo, de audio, o ambos. Sin embargo, no todos los formatos contenedores (mp4, mxf, avi, mov, ogg, mkv, etc.) son compatibles con todos los códecs. Algunos incluso sólo son compatibles con un único códec.

Hoy día se tiende a hacer bastante uso de los contenedores mp4, mov, mkv y mxf debido a su popularidad y a su versatilidad a la hora de embeber información generada por distintos códecs.

Códec de vídeo

Un códec de vídeo es el programa informático o dispositivo hardware capaz de codificar o decodificar una señal de vídeo, generalmente aplicando compresión. Un ejemplo típico de códec usado en vídeo es H264.

Códec de audio

Un códec de audio es el programa informático o dispositivo hardware capaz de codificar o decodificar una señal de audio, generalmente aplicando compresión. El clásico ejemplo de códec de audio es MP3.

Otros streams de datos

Un contenedor de vídeo es capaz, por lo general, de almacenar información de vídeo y audio, pero puede ser capaz de almcenar otro tipo de datos. De esta forma algunos formatos contenedores son capaces de tener metadatos, así como subtítulos, menús, idiomas, etc.

2 comentarios. Dejar nuevo

Excelente información presentada en forma simple y comprensible.

Exquisito